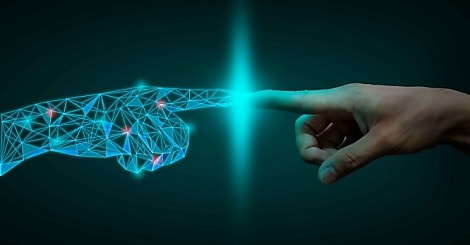

Deepfake : comment se protéger ?

Les cybercriminels perfectionnent de plus en plus leurs attaques, notamment en utilisant l'IA. Les entreprises, grands groupes comme PME et ETI, doivent se préparer à y faire face en renforçant leurs protocoles, formant leurs collaborateurs... et en utilisant l'intelligence artificielle à leur tour !

L'intelligence artificielle touche désormais tous les domaines. Et même celui de la cybercriminalité. En effet, les cybercriminels utilisent l'IA pour construire des architectures de données fictives immersives (ADFI). « Cela consiste à créer, à partir de données, un environnement de confiance pour la cible pour l'amener à effectuer une action - un virement bien souvent - sans que le doute n'apparaisse », décrit Thierry Berthier, pilote du groupe "Sécurité intelligence artificielle" chez Hub France IA. Autrement dit, avec l'intelligence artificielle, les opérations de fraude comme les arnaques au président ou les faux fournisseurs vont être de plus en plus difficiles à détecter.

Double numérique

Comment cela fonctionne-t-il ? « La vidéo d'un chef d'entreprise, même de seulement cinq minutes, peut être insérée dans des outils d'intelligence artificielle afin de créer un double numérique ; il sera ensuite possible de lui faire dire ce que l'on veut », explique Thierry Berthier. Ainsi, la cible aura vraiment l'impression de parler à son patron, que ce soit par téléphone ou par visioconférence ; elle n'aura plus de doute et effectuera les actions demandées en toute confiance.

De même, il est possible d'imiter à la perfection des sites Internet et même des adresses web, si bien que rien ne paraît anormal. « Les outils d'IA sont de plus en plus accessibles en open source gratuitement ; les attaquants peuvent donc utiliser ces outils facilement », rapporte Thierry Berthier.

A travers le deepfake, les cybercriminels ne laissent pas le doute s'installer et réussissent ainsi à contourner les éléments de sécurité mis en place pas les entreprises. En effet, comme le fait remarquer Thierry Berthier, « les protocoles, comme rappeler la personne pour s'assurer de la demande, sont mis en oeuvre en cas de doute. C'est quand il n'y a aucun doute que les problèmes surviennent ».

Utiliser l'IA pour se protéger

Alors que faire ? Thierry Berthier conseille de rendre plus robustes les protocoles de paiement, via des contrôles systématiques (même quand il n'y a pas de doute) et de la double authentification. Il invite aussi à utiliser l'IA qui peut permettre de détecter des choses indétectables à l'oreille ou à l'oeil nu et déterminer s'il y a des risques que le document soit un deepfake ou non.

Thierry Berthier parle aussi de User and Entity Behavior Analytics (UEBA) qui consiste en un outil d'intelligence artificielle qui analyse ce qui se passe sur le SI de l'entreprise, afin d'établir un modèle statistique de normalité de fonctionnement. « A partir de ce modèle, l'outil détecte des anormalités, des chaînes de phénomènes anormaux », précise-t-il. L'IA est donc utilisé par les attaquants mais peut aussi se révéler efficace en termes de défense.

Attention cependant : ce n'est pas parce qu'on est équipé d'un outil qu'on est protégé ! II faut le faire évoluer pour qu'il corresponde aux attaques, toujours plus perfectionnées.

Organiser des simulations

Le facteur humain ne doit pas non plus être négligé. « Une enquête Gartner menée en mai et juin 2022 auprès de 1 310 employés a révélé que 69 % d'entre eux ont contourné les directives de leur organisation en matière de cybersécurité au cours des 12 derniers mois. Dans l'enquête, 74 % des employés ont déclaré qu'ils seraient prêts à contourner les conseils en matière de cybersécurité si cela les aidait, eux ou leur équipe, à atteindre un objectif commercial », rapporte Émilie Audubert, analyste pour Capterra.

Il s'agit donc de sensibiliser les employés afin qu'ils prennent au sérieux la lutte contre la criminalité. Et pour cela, l'intelligence artificielle peut s'avérer intéressante. Émilie Audubert conseille de créer des deepfakes et de les utiliser pour mettre les collaborateurs en situation d'attaque. « Ces simulations permettent de les habituer à faire face aux menaces des cybercriminels », indique-t-elle.

Lire aussi : Julien Galinat, véritable « business partner » à la tête de la finance chez Rakuten France

Ces entraînements doivent être réguliers pour être efficaces. Même si, comme le fait remarquer Thierry Berthier, il faut rester très humble face aux attaques. « Même quand on est très bien formé on peut se faire piéger. Il ne faut jamais sous-estimer les attaquants car les enjeux financiers sont très importants », souligne-t-il. Et c'est aussi pour cette raison que les entreprises doivent prendre ce risque au sérieux.

Sur le même thème

Voir tous les articles Cyber & Climat

![Face à l'IA, les directions financières en attente d'un gain de [...]](https://cdn.edi-static.fr/image/upload/c_lfill,h_201,w_298/e_unsharp_mask:100,q_auto/f_auto/v1/Img/BREVE/2025/8/484632/face-directions-financieres-attente-gain-productivite-probant-L.jpg)